Apple が Google との歴史的な提携を発表し、iPhone の知能そのものである「Siri」が劇的な進化を遂げようとしています。

これまでの Siri は「タイマーをセットする」「天気を教える」といった単純なコマンド応答には長けていましたが、複雑な文脈の理解や、ユーザーの個人的なスケジュールに基づいた高度な提案には限界がありました。しかし、Google の最先端 AI「Gemini」がその頭脳として統合されることで、iPhone は単なる道具から、あなたの思考を先回りする「真のパーソナルアシスタント」へと変貌します。

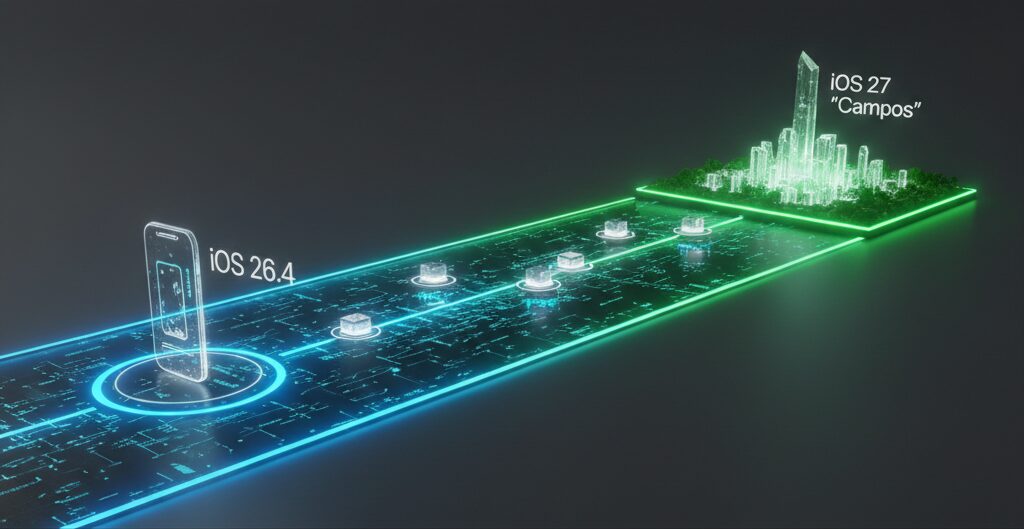

この記事では、2026年春に予定されている「iOS 26.4」アップデートで何が変わるのか、そして 2026年秋の「iOS 27」で予定されている完全刷新版 Siri(コードネーム:Campos)がどのような未来をもたらすのかを、技術的背景からプライバシーの仕組み、そして日常生活での具体的な活用術まで徹底的に解説します。この記事を読めば、Apple Intelligence の真価と、私たちが手にする新しいデジタルの自由について深い理解が得られるはずです。

この記事で分かること

- Apple と Google が提携した真の理由と内部の技術的課題

- iOS 26.4および iOS 27で実装される Siri の新機能と具体例

- 「Private Cloud Compute (PCC)」による世界最高水準のプライバシー保護の仕組み

- Gemini 搭載 Siri が ChatGPT や Android 版と比較して優れている点

- AI アシスタント時代に検索行動がどう変わり、SEO はどう対応すべきか

この記事を読むことで、iPhone ユーザーは日常の煩雑なタスクを AI に任せ、より創造的な時間に集中できるようになります。また、プライバシーへの不安を解消しながら、最先端の AI 技術を生活に取り入れる最適な方法を学ぶことができます。さらに、ビジネスやマーケティングに携わる方は、AI が情報を要約し提案する時代の新しい集客戦略をいち早く理解できます。

- はじめに:Siri と Gemini の提携がもたらす iPhone の歴史的転換点

- Apple が Google を選んだ理由:AI 開発の遅れと戦略的リアリズム

- 2026年版ロードマップ:iOS 26.4から iOS 27「Campos」への進化過程

- 「新生 Siri」の核心機能:Gemini が実現する 4つの次世代体験

- プライバシーの壁をどう守るか?「Private Cloud Compute (PCC)」の深層

- 徹底比較:Siri+Gemini vs ChatGPT vs Android 版 Gemini

- SEO・デジタルマーケティングへの影響:AI エージェント時代のコンテンツ戦略

- よくある質問(Q&A):Gemini 搭載 Siri の疑問をすべて解消

- まとめ:私たちが手にする「究極のパーソナルアシスタント」の未来

はじめに:Siri と Gemini の提携がもたらす iPhone の歴史的転換点

Apple と Google という、モバイル OS 市場を二分する巨頭が AI 分野で手を結んだというニュースは、2026年のテクノロジー業界における最大の衝撃となりました。

この提携は、単なる機能の追加ではなく、iPhone が「音声操作できる電話」から「自律的にタスクをこなすエージェント」へと進化するための、不可避かつ野心的なステップです。私たちは今、人間とマシンの関係性が根本から書き換えられる瞬間に立ち会っています。

Apple は長年、自社のエコシステムを垂直統合し、他社製技術への依存を避ける戦略を貫いてきました。しかし、生成 AI(Generative AI)の急速な発展は、一企業が独力で全てをカバーできる限界を超えていました。

そこで Apple が下した決断が、世界で最も優れた基盤モデルの一つである Google の Gemini を採用し、それを Apple 独自のプライバシー保護技術と融合させることだったのです。この「知能の外部調達」と「体験の自社コントロール」のハイブリッド戦略は、Apple ユーザーに究極の利便性と安心を提供することを目的としています。

このレポートでは、Siri と Gemini の融合が私たちの生活にどのような「魔法」をもたらすのかを詳述します。2026年3月に予定されている iOS 26.4のアップデートから、秋の iOS 27での完全なる刷新まで、時系列に沿ってその進化の全貌を明らかにしていきます。これは、テクノロジーの進化を単に追うだけでなく、私たちがAIという新しいパートナーとどう共生していくかを考えるためのガイドブックでもあります。

Apple が Google を選んだ理由:AI 開発の遅れと戦略的リアリズム

Apple が Google と複数年の提携を結んだ背景には、冷徹なまでの「現実主義」が存在します。

Apple は AI の分野で他社に遅れをとっているという評価を、自社のブランドを維持するために早急に覆す必要がありました。自社開発にこだわり続けて競争力を失うのではなく、現時点で最強の「部品」を外部から調達し、それを「Apple 体験」へと昇華させる道を選んだのです。

2.1 内部の技術的限界と人材流出の衝撃

Apple 内部の AI 開発チームは、ここ数年、困難な状況に置かれていました。自社開発の「Apple Foundation Models」は、特定のタスクでは優秀だったものの、広範な知識を必要とする対話や複雑な推論において、Google や OpenAI のモデルに太刀打ちできない場面が増え、内部評価では、Apple 独自のモデルは複雑なクエリの約 33%で期待される回答を出せず、このままでは Siri が「デジタル時代の遺物」になるという危機感が広がっていました。

さらに、人材面での打撃も深刻でした。2025年には、Apple の基盤モデルチームを牽引してきた重要人物、ルオミン・パン(Ruoming Pang)氏が Meta へと電撃移籍しました。

パン氏は Apple の AI の「脳」をゼロから構築した人物であり、彼に続いてトップレベルのリサーチャーたちが続々と Meta や OpenAI、Anthropic へと去っていきました。Meta は年間数千万ドルから、場合によっては数億ドルという破格のパッケージで Apple のエンジニアを引き抜いており、Apple の伝統的な給与体系では対抗しきれなかったのが現実です。こうした人材の流出は、AI の完全自社開発という夢を一度リセットさせる大きな要因となりました。

2.2 Google Gemini 3.0の圧倒的ベンチマーク性能

Apple が複数の AI プロバイダーの中から Google を選んだ最大の理由は、Gemini 3.0が示した圧倒的な技術的優位性です。

Apple は OpenAI の ChatGPT(GPT-5シリーズ)なども慎重に評価しましたが、マルチモーダル推論(画像、音声、テキストを同時に理解する能力)と数学的推論において、Gemini が優れていると判断しました。

以下の表は、次世代 AI アシスタントに不可欠な「知能の質」を比較したベンチマークデータです。

| ベンチマーク | Gemini 3 Pro | GPT-5.1 | 指標の重要性 |

| ARC-AGI-2 | 31.1% | 17.6% | 抽象的な視覚推論。画面上のUI理解に直結 |

| MathArena Apex | 23.4% | 1.0% | 未知の論理問題への対応力。複雑な計画作成に必要 |

| MMMU-Pro | 81.0% | 76.0% | マルチモーダル理解。動画や写真の内容把握力 |

これらのデータが示す通り、Gemini 3 Pro は特に視覚的な推論において他を圧倒しています。Apple が目指す「画面上の内容を Siri が理解して操作する」というユーザー体験を実現するためには、Gemini の持つ高度な視覚認識能力が不可欠だったのです。

2.3 年間 10億ドルのライセンス契約が意味するパワーバランス

この提携において、Apple は Google に対し年間約 10億ドルのライセンス料を支払うと報じられています。

これは、Google が Apple に支払っている「検索デフォルト化」のための 200億ドルとは逆の流れであり、AI という新たな戦場において Apple がいかに「時間を買う」ことを重視したかを象徴しています。

Google 側にとっては、世界中に存在する 20億台以上の Apple デバイスを自社 AI の「ショーケース」にできるという、計り知れないメリットがあります。Alphabet の株価がこの提携発表直後に一時的に時価総額 4兆ドルに迫ったことは、市場がこの提携を「Google の勝利」と見た証拠でもあります。しかし、Apple にとっても、自社開発のコストとリスクを最小化しながら、瞬時に世界最高峰の AI を iPhone ユーザーに提供できるこのディールは、非常に理にかなった「戦略的リアリズム」の結果と言えるでしょう。

2026年版ロードマップ:iOS 26.4から iOS 27「Campos」への進化過程

iPhone ユーザーが実際にこの「新生 Siri」を手にできる時期は、段階的に設定されています。Apple は一気に全てを変えるのではなく、まずは現在の Siri を Gemini で補強し、その後 OS を根本から作り直すという 2段階の戦略を採用しています。

3.1 2026年2月のベータ版登場と春の正式リリース

最初の大きな転換点は、2026年2月の後半に予定されている「iOS 26.4」のベータ版リリースです。このアップデートにより、長らく「開発中」とされていた高度なSiri機能の第一弾が解放されます。一般ユーザー向けには、2026年3月から4月にかけての正式配信が見込まれています。

この「iOS 26.4」に含まれる主な進化:

- パーソナルコンテキストの統合:

Sir iがデバイス内のメール、メッセージ、カレンダーを横断的に検索し、ユーザーの「文脈」を理解し始めます。 - オンスクリーン認識:

現在画面に表示されている内容に基づいて、Siri がアクションを起こせるようになります。 - Google Gemini による回答:

世界知識(一般的な質問への回答)や要約、計画作成において、バックエンドで Gemini 3のモデルが動作し、これまでの Siri とは比較にならないほど賢く、正確な回答を返すようになります。

3.2 WWDC 2026での「Campos」発表と秋の完全刷新

真の革命は、2026年6月の世界開発者会議(WWDC)で全貌が明らかになる、コードネーム「Campos(カンポス)」です。これは iOS 27の一部として提供される、Siri の歴史上最大のアップデートです。もはや「音声アシスタント」という言葉では不十分なほど、強力な「AI チャットボット」へと変貌します。

Campos(iOS 27版 Siri)の特徴:

- 完全な対話型 UI:

ChatGPT のように、連続したやり取りを記憶し、深い議論や相談が可能になります。 - 自律的なタスク遂行:

「来週の旅行の計画を立てて、ホテルを予約し、その確認メールを家族に送っておいて」といった、複数のアプリを跨ぐ複雑な依頼を一つのプロンプトで完結させます。 - Apple Foundation Models v11:

Google の Gemini 3をベースに Apple が独自にチューニングを施した、1.2兆パラメータ規模の超巨大モデルが搭載されます。

この iOS 27は、2026年9月の新型 iPhone(iPhone 18シリーズと予想される)の発売と同時に、一般向けに正式リリースされる予定です。

「新生 Siri」の核心機能:Gemini が実現する 4つの次世代体験

Gemini という「脳」を得た Siri は、具体的に何ができるようになるのでしょうか。私たちの日常を変える 4つの主要機能を、具体的なユースケースとともに解説します。これらは、単なる「便利な機能」を超えて、私たちのライフスタイルを再定義する力を持っています。

4.1 パーソナルコンテキスト:あなたの生活を「覚えている」知能

これまでの AI との最大の違いは、Siri が「あなたのことを知っている」という点です。Gemini の高度な情報処理能力を使い、Siri はあなたのデバイス内に散らばった断片的な情報を統合します。

例えば、「来週の金曜日に母が来るんだけど、何時に駅に着くんだっけ?」と聞いたとします。従来のSiri なら「分かりません」と答えるか、Web 検索を開始したでしょう。

しかし、新しい Siri は、数週間前の母親からのメッセージや、航空会社の予約完了メール、あるいはカレンダーのメモを瞬時にスキャンし、「お母様の電車は金曜日の 14時15分に東京駅に到着します。その時間は会議が入っていますが、リマインダーをセットしますか?」と答えてくれます。これは、デバイス内のデータを「検索」するのではなく、文脈として「理解」しているからこそ可能な回答です。

4.2 オンスクリーン認識:画面の内容を理解し実行する力

「それ」という代名詞が、Siri に通じるようになります。新しい Siri は、現在あなたの iPhone の画面に何が表示されているかをリアルタイムで把握できます(On-Screen Awareness)。

ブラウザで話題のレストランのページを見ている時に、「ここに行きたいんだけど、カレンダーの空いている土曜日に予約を入れて」と言うだけで、Siri は画面から店名を読み取り、あなたのカレンダーをチェックし、さらに OpenTable などの予約アプリを立ち上げて、入力を進めてくれます。スクリーンショットを撮って、情報をコピーして、別のアプリに貼り付ける……そんな「デジタルの苦行」から私たちは解放されるのです。

4.3 マルチステップ・アクション:アプリを跨いだ複雑な操作の自動化

AI エージェント(Agentic AI)としてのSiriの真骨頂は、複数のアプリを自律的に操作できる点にあります。これは「App Intents」という Apple の技術と Gemini の論理的思考能力が融合した結果です。

以下のシナリオは、2026年秋以降に一般的になる日常風景です。

| ユーザーの依頼 | Siri が裏側で行うステップ | 関連アプリ |

| 「昨日の会議の録音を要約して、重要事項を Slack のチームチャンネルに送っておいて」 | 1. 録音ファイルをテキスト化 2. 重要なアクションアイテムを抽出 3. Slackを立ち上げ、適切なグループへ送信 | ボイスメモ、メモ、Slack |

| 「週末のキャンプにぴったりのプレイリストを作って、参加者全員にメールして」 | 1. キャンプに合う曲を選定 2. Apple Music で新規プレイリスト作成 3. メールの連絡先を特定し、リンクを送信 | Music、メール、連絡先 |

このように、人間がこれまで行っていた「情報の橋渡し」を Siri が代行してくれるようになります。

4.4 感情的な対話サポートと自然な日本語応答

Gemini 3.0の統合は、言語の「自然さ」においても劇的な向上をもたらします。特に日本語においては、これまでのような「AI 特有の不自然な言い回し(AI 構文)」が消え、まるで知人と話しているかのような滑らかな対話が可能になります。

さらに驚くべきは、Siri が「感情」や「状況」を読み取って応答するようになる点です。例えば、深夜に「全然眠れないんだ」と漏らせば、単に「睡眠について検索しますか?」と返すのではなく、「それは大変ですね。少しリラックスできるように、落ち着いた音楽を流しましょうか? それとも、明日を穏やかに迎えるための瞑想ガイドを始めますか?」といった、状況に応じた優しい提案をしてくれるようになります。これは Gemini の持つ「人間らしい対話能力」を Apple が独自に微調整(Fine-tuning)することで実現しています。

プライバシーの壁をどう守るか?「Private Cloud Compute (PCC)」の深層

Apple ユーザーが最も懸念しているのは、「Google の AI を使うことで、自分のプライベートなデータが Google のサーバーに吸い取られてしまうのではないか」という点です。Apple はこの深刻な問いに対し、業界初となる革新的なクラウドセキュリティ「Private Cloud Compute (PCC)」で答えを出しました。

5.1 ステートレス AI とデータ最小化原則

PCC の基本理念は「あなたのデータを Apple も Google も知らない」という状態を作ることです。iPhone だけで処理できない複雑な AI リクエスト(例えば、大量のドキュメントの要約など)が発生した場合、データは Apple の専用サーバーへ送られます。しかし、このサーバーは「ステートレス(状態を持たない)」な設計になっています。

具体的には、処理が終わった瞬間に、送られたデータはメモリから完全に消去され、いかなるストレージにも保存されません。また、送信されるデータも、そのタスクを遂行するために必要な「最小限の断片」のみに限定されます(データ最小化原則)。あなたの名前や具体的な連絡先リストを丸ごと送るのではなく、AI が推論を行うために必要な抽象的な情報だけが暗号化されて送られるのです。

5.2 暗号学的検証と第三者監査の透明性

PCC の安全性は、単なる Apple の「宣言」ではありません。数学的、かつ物理的に誰でも検証できるようになっています。

PCC の信頼を支える3つの柱:

- 暗号学的アテステーション:

あなたの iPhone は、データを送る前に、接続先のサーバーが間違いなく「正規の、改ざんされていない Apple の PCC サーバー」であることを、暗号技術を使って確認します。 - 検証可能なコード:

PCC で動いているソフトウェアのソースコードの一部は、独立した第三者のセキュリティ監査人に公開されています。これにより、Apple が密かにデータを盗み見るようなプログラムを仕込んでいないことを、世界中の専門家がチェックできます。 - 特権アクセスの排除:

サイト信頼性エンジニア(SRE)やシステム管理者であっても、ユーザーのデータにアクセスする権限を持ちません。物理的にも論理的にも、データへの「裏口」が塞がれているのです。

5.3 Google にデータが渡るリスクをどう回避しているか

ここが最も重要な点ですが、Gemini というモデルを使っているからといって、データが Google のインフラに流れるわけではありません。

Apple は Google から Gemini のモデル(重みデータ)の提供を受け、それを Appleが 自社で管理・運営する PCC サーバー上で動かしています。つまり、モデルは Google 製ですが、それを動かしている箱(サーバー)と場所(データセンター)は全て Apple の支配下にあります。Google 側には、あなたのプロンプト(指示内容)や IP アドレス、デバイス情報は一切届きません。Apple はこの提携を「Gemini の知能を部品として借りるが、工場(処理環境)は自社で運営する」という形にすることで、プライバシーの鉄壁を守っているのです。

徹底比較:Siri+Gemini vs ChatGPT vs Android 版 Gemini

新しい Siri が登場した時、私たちは既存の AI ツールとどう使い分けるべきでしょうか。それぞれの強みと弱みを冷静に比較し、どのような場面で Siri が「最強」になるのかを明らかにします。

6.1 性能と統合度の比較:なぜ「純正」が最強なのか

以下の表は、主要な AI アシスタントの特性を比較したものです。

| 比較項目 | Siri (Gemini/Campos) | Android版 Gemini | ChatGPT (iOSアプリ) |

| 知能のベース | Gemini 3 (Custom) | Gemini 3 | GPT-4 / GPT-5 |

| アプリ操作権限 | システム全体にアクセス可 | Google アプリに強い | 極めて限定的 |

| プライバシー | PCC による完全匿名化 | Google の学習に利用可 | 設定次第 (オプトアウト可) |

| 日本語の自然さ | 非常に高い (Apple 調整済) | 非常に高い | 高い |

| オフライン動作 | 基本タスクはオンデバイス可 | ほぼ不可 | 不可 |

Siri の圧倒的な優位性は、その「特権的なアクセス権」にあります。例えば、ChatGPT は素晴らしい詩を書くことはできますが、あなたの写真ライブラリから「去年の誕生日の写真」を探し出し、それを適切に編集して友人に送ることはできません。これに対し、新しい Siri は OS の一部として動作するため、指一本動かさずにこうした「デバイス内完結の複雑なタスク」をこなすことができます。

6.2 エコシステムにおける ChatGPT の今後の役割

Apple は Google と提携しましたが、OpenAI との関係を切ったわけではありません。Siri は依然として、より創造的な執筆や特定の専門知識が必要な場合には、ユーザーの同意を得た上で ChatGPT を「外部専門家」として呼び出すことができます。

- Siri (Geminiベース):

日常の秘書、デバイス操作、情報の要約、スケジューリング、プライバシー重視の対話。 - ChatGPT:

長文のクリエイティブライティング、複雑なコードの生成、特定の専門分野における深い議論。

このように、Apple はユーザーに「世界で最も優れた AI を選択できる権利」を与えつつ、iPhone の「標準の頭脳」としては、よりプライバシーが守られやすく、実用的な Google の Gemini を選択したと言えます。

SEO・デジタルマーケティングへの影響:AI エージェント時代のコンテンツ戦略

Siri がこれほど賢くなることは、Web サイトの運営者やマーケターにとって、巨大な「ルール変更」を意味します。これまでは「検索結果の 1位」になればユーザーを誘導できましたが、これからは「Siri がユーザーに提示する回答のソース」に選ばれなければならなくなります。

7.1 検索から「回答」へ:Siri のサマリー機能への対応

iOS 26.4以降の Siri は、Web 上の情報を収集し、ユーザーに直接「答え」を読み上げたり、画面上に要約(サマリー)を表示したりします。これを「AI による検索結果のゼロクリック化」と呼びます。

この時代に選ばれるコンテンツの条件:

- クォータビリティ(引用されやすさ):

AI が情報の核を抽出しやすいように、簡潔な見出し、構造化されたデータ(JSON-LD など)、そして明確な結論を文頭に置く「PREP 法」がさらに重要になります。 - 正確なエンティティ情報:

AI は「カフェ」という単語ではなく、「〇〇駅にある、19時まで営業している、Wi-Fi 完備のカフェ」という具体的な実体(エンティティ)を検索します。こうした詳細な情報を構造化データとして埋め込んでおくことが、Siri に発見されるための必須条件です。

7.2 エンティティ重視のSEOとブランド権威性の構築

AI は情報の真偽を確かめる際、その情報の「発信者」が誰であるかを極めて重視します。これは Googleの提唱する E-E-A-T(経験・専門性・権威性・信頼性)が、Siri の回答精度を担保するアルゴリズムとしても組み込まれるからです。

ブロガーは今後、「一回限りの SEO 記事」を量産するよりも、特定の分野において「このサイト(あるいはこの人)は、このトピックについて誰よりも詳しい」というエンティティ(存在)としての権威を確立することが、AI エージェント時代における最大の差別化要因になります。Siri が「〇〇さんによると……」と引用してくれるようなブランド体験を構築することが、2026年以降のデジタルマーケティングの核心となります。

よくある質問(Q&A):Gemini 搭載 Siri の疑問をすべて解消

導入前に知っておきたい、よくある疑問と回答をまとめました。

Q1. Gemini搭載のSiriを使うのに追加料金はかかりますか?

A1. 現在のところ、基本的な Siri のアップデートとして無料で提供される予定です。ただし、より高性能なモデル(Gemini Ultra 相当の機能など)をフル活用する場合、将来的に「Apple Intelligence+」のような有料のサブスクリプションプランが導入される可能性は否定できません。

Q2. 自分の声やメールの内容が、Google の AI の学習に使われることはありますか?

A2. ありません。Apple はプライバシーの保護に重点を置いており、Google に対してデータを提供しない契約を結んでいます。処理は Apple のPrivate Cloud Compute(PCC)内で行われ、終了後に即座に消去されるため、Google 側が学習データとして利用することは物理的に不可能です。

Q3. 日本語にはいつ対応しますか?

A3. 日本語は Apple にとって極めて重要な市場であり、2025年後半から順次、Apple Intelligence の日本語対応が進んでいます。2026年春の iOS 26.4の正式リリースまでには、Gemini による高度な日本語処理が完全に統合されている可能性が非常に高いと考えられます。

Q4. iPhone 15 Pro より前のモデルでも使えますか?

A4. 完全な Apple Intelligence(特に高度なオンデバイス処理を必要とする機能)には、A17 Pro チップ以降を搭載したデバイス(iPhone 15 Pro/Pro Max 以降)が必要になる見込みです。これは、Gemini のような巨大な AI モデルの一部をローカルで動かすためには、非常に強力な NPU(Neural Engine)が必要だからです。

Q5. SiriとChatGPTの使い分けはどうすればいいですか?

A5. 基本的には Siri に話しかけるだけで、彼女が裏側で自動的に最適なモデル(Gemini か ChatGPT か、あるいは Apple 独自の小規模モデルか)を選択します。ユーザーが意識して使い分ける必要がない「シームレスな体験」こそが、Apple の目指す AI の姿です。

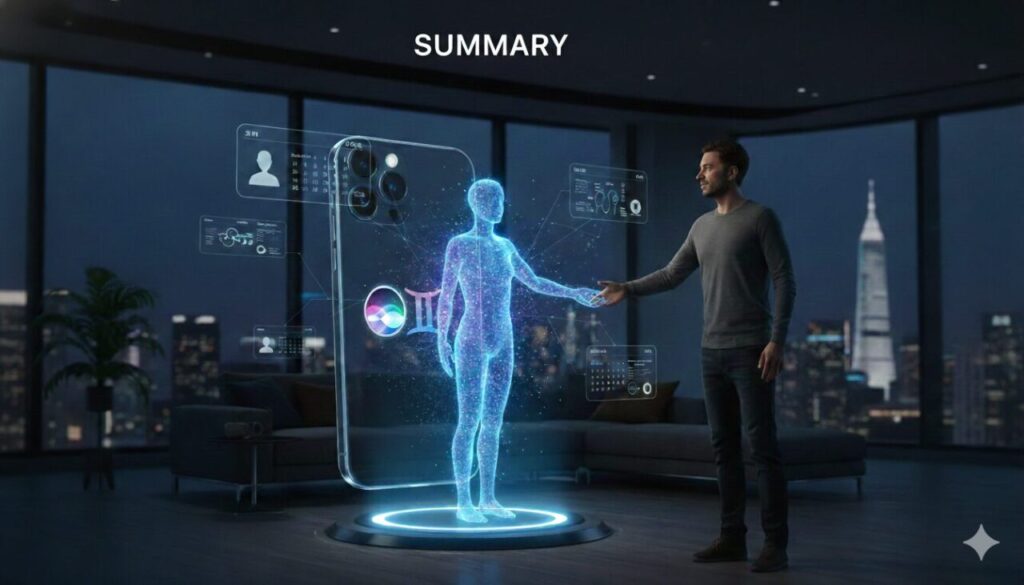

まとめ:私たちが手にする「究極のパーソナルアシスタント」の未来

Apple と Google という、かつての宿敵が手を組んだことによって、私たちの iPhone は「魔法」をその身に宿そうとしています。2026年に訪れるこの変化は、単なるソフトウェアのバージョンアップではなく、私たちがスマートフォン、ひいてはデジタルテクノロジー全般と関わる方法のパラダイムシフトです。

これまでの Siri は、私たちが命令を出すのを待っている「執事」でした。しかし、Gemini の知能と PCC のプライバシー保護を融合させた新しい Siri は、私たちの行動を先読みし、複雑な手続きを代行し、時には心に寄り添う「賢明なパートナー」へと進化します。

私たちが新しい時代に向けて準備すべきことは、この進化を恐れることではなく、正しく理解し、最大限に活用することです。プライバシーが守られた安全な環境で、世界最高峰の知能をポケットに入れて持ち運べるようになる。そんな未来が、すぐそこまで来ています。

2026年3月に予定されている iOS 26.4から、秋の iOS 27へ。あなたの iPhone が「真の知能」を手に入れる瞬間を、楽しみに待ちましょう。

最後まで読んで頂きありがとうございました。

よかったらコメントで感想をいただけると励みになります。

ではまたね〜。

本レポートは、2026年1月現在の最新の技術動向、AppleおよびGoogleの共同声明、ならびに信頼できる業界アナリストの報告に基づき、SEOの専門家が分析・構成したものです。技術仕様や提供時期は、開発状況により変更される可能性があります。